L’exemple de la France

À travers un exemple, il s’agit de montrer que la logique de la Smart City/Safe City a aussi pénétré le niveau de l’État, et a notamment les caractéristiques suivantes :

Massification et agrégation des données ;

Automatisation de la prédiction, voire de la décision administrative ;

Recherche de l’efficacité et de l’optimisation ;

Prévention et punition des délits.

CAF, profilage et prédiction de fraude

En France, les administrations (assurance maladie et vieillesse, France Travail, CAF...) assignent automatiquement des notes à la population, visant dans le discours officiel à détecter le non-recours aux droits, à optimiser l’allocation de ressources et à lutter contre la fraude.

Complément :

La Quadrature du Net centralise les informations sur l’utilisation d’algorithmes dans le service public sous l’initiative France Contrôle ( laquadrature.net[2]).

Les CAF s'appuient sur [les algorithmes] pour une finalité de lutte contre le non-recours aux prestations sociales (au profit de personnes éligibles à des aides sociales mais qui, pour diverses raisons, ne bénéficient pas des systèmes de protection sociale. [...] Votre dernier score est de 0,21193981506 au titre de janvier 2025. [...] Voici les principaux éléments principaux de calcul : [...]

Montant des prestations légales [...]

Montant des revenus d’activité [...]

Nombre de téléprocédures sur 18 mois.

— Courrier de la CAF adressé à l'auteur, mars 2025

Complément : Un périmètre bien plus large

Administré par la Caisse nationale d'assurance vieillesse (CNAV), le DRM (« dispositif ressources mensuelles ») [...] centralise la quasi-totalité des données relatives aux revenus de la population connus de l'administration fiscale. [...] Le DRM pourra désormais être utilisé [par la CAF et la CNAV] « pour améliorer la méthode de profilage des allocataires visant à identifier les situations justifiant la mise en œuvre prioritaire d'un contrôle » [...] il s'agit d'une phase de test qui vise à évaluer le gain de productivité du dispositif.

CNIL, délibération 2023-120, je souligne.

Une tendance en forte augmentation

Définition : Observatoire des algorithmes publics (ODAP)

Créé par « des spécialistes et chercheur·euses en sciences sociales, politiques publiques, droit, design et ingénierie », l’initiative « crée et rassemble des informations sur les algorithmes utilisés par les administrations françaises, pour les rendre plus transparents. »

Complément : Transparence ?

Si, en théorie, depuis 2016, les administrations ont désormais une obligation de transparence algorithmique :

[elles] publient en ligne les règles définissant les principaux traitements algorithmiques utilisés dans l'accomplissement de leurs missions lorsqu'ils fondent des décisions individuelles

Article L312-1-3 du Code des relations entre le public et l'administration

En pratique ils restent opaques et les dirigeants vont parfois même jusqu’à nier leur existence et refuser de transmettre tout document (CADA, avis n°20247163).

Exemple : Combien ?

Au 26 novembre 2025, on compte 120 algorithmes répertoriés, dont une partie reste opaque voire secrète et dont l’existence n’est connue que par des fuites.

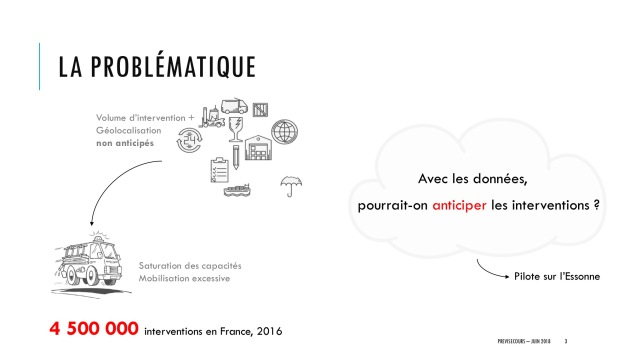

Exemple : Previsecours

Un modèle prédictif du volume d’interventions et de leur géolocalisation peut permettre d’anticiper les moyens opérationnels à mobiliser au sein des différentes casernes. Une meilleure gestion prévisionnelle des moyens est de nature à répondre aux demandes d’intervention plus rapidement en mobilisant un maximum de moyens uniquement lorsque cela est utile.

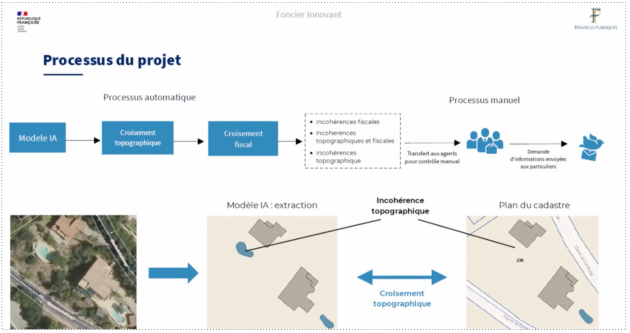

Exemple : Foncier Inovant : détection de piscines non-déclarées

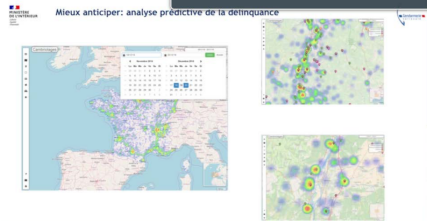

Exemple : PAVED

Pour « Plateforme d’analyse et de visualisation évolutive de la criminalité », dévelopée au sein du Service Central de Renseignement Criminel (SCRC) de la Gendarmerie nationale.

[...] utilise des méthodes d’intelligence artificielle pour prédire deux types de crimes : les vols de véhicules et les cambriolages, au niveau local (la rue) pour le ou les quelques jours suivants (jusqu’à une semaine). [...] [La Gendarmerie nationale] emploie des termes plus neutres ou purement techniques comme « analyse du risque criminel », « méthode analytique prédictive », « analyse prédictive », « outil d’aide à la décision » [...].

LQDN, 2024[6], pp. 25 et 27.

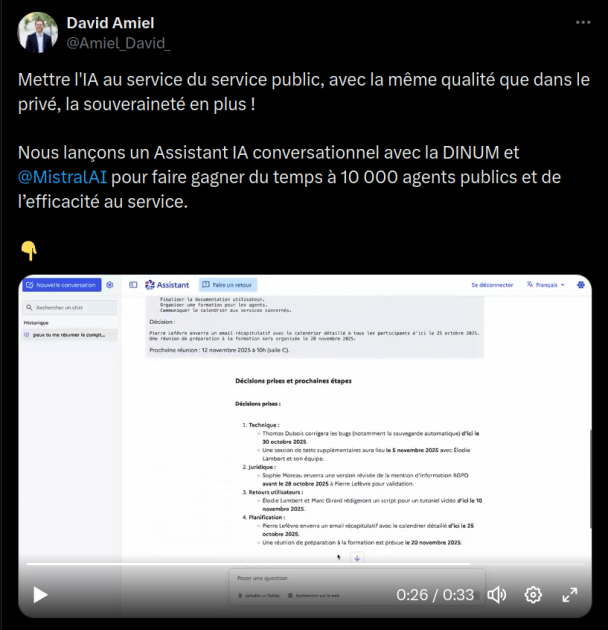

Exemple : IAG « spécial fonctionnaires »

Focus sur la justice

Exemple : Cour de cassation

Le modèle d’IA [existant] a ainsi permis d’accélérer grandement le processus d’orientation vers les chambres de la Cour et de gagner en précision dans l’orientation des mémoires ampliatifs vers les sections compétentes au sein des chambres.

Cour de Cassation, 2025[9], p. 30

[c]ertains cas d’usage plus complexes [...] nécessitent un investissement plus lourd, mais qui apparaît pleinement justifié. Il s’agit, en ce qui concerne l’exploitation des écritures des parties, des cas d’usage de recherche de connexité matérielle et intellectuelle ainsi que des cas d’usage de détection des précédents et rapprochements de jurisprudence dans l’analyse des mémoires ampliatifs.

Il s’agit également des cas d’usage relatifs à l’exploitation des bases de données documentaires : les RAG [génération à enrichissement contextuel] ou encore les cas d’usage d’aide aux rapprochements de jurisprudence, divergences internes à la Cour de cassation [...]

Cour de Cassation, 2025[9], pp. 113-114

Exemple : Agent conversationnel juridique

Remarque : Éléments de communication de Doctrine

L'IA juridique de Doctrine soulage les avocats et juristes des tâches répétitives et chronophages d’analyse du dossier, recherche juridique et rédaction pour qu’ils sécurisent leur positions juridiques et gagnent en productivité.

doctrine.fr, consulté le 26 novembre 2025.